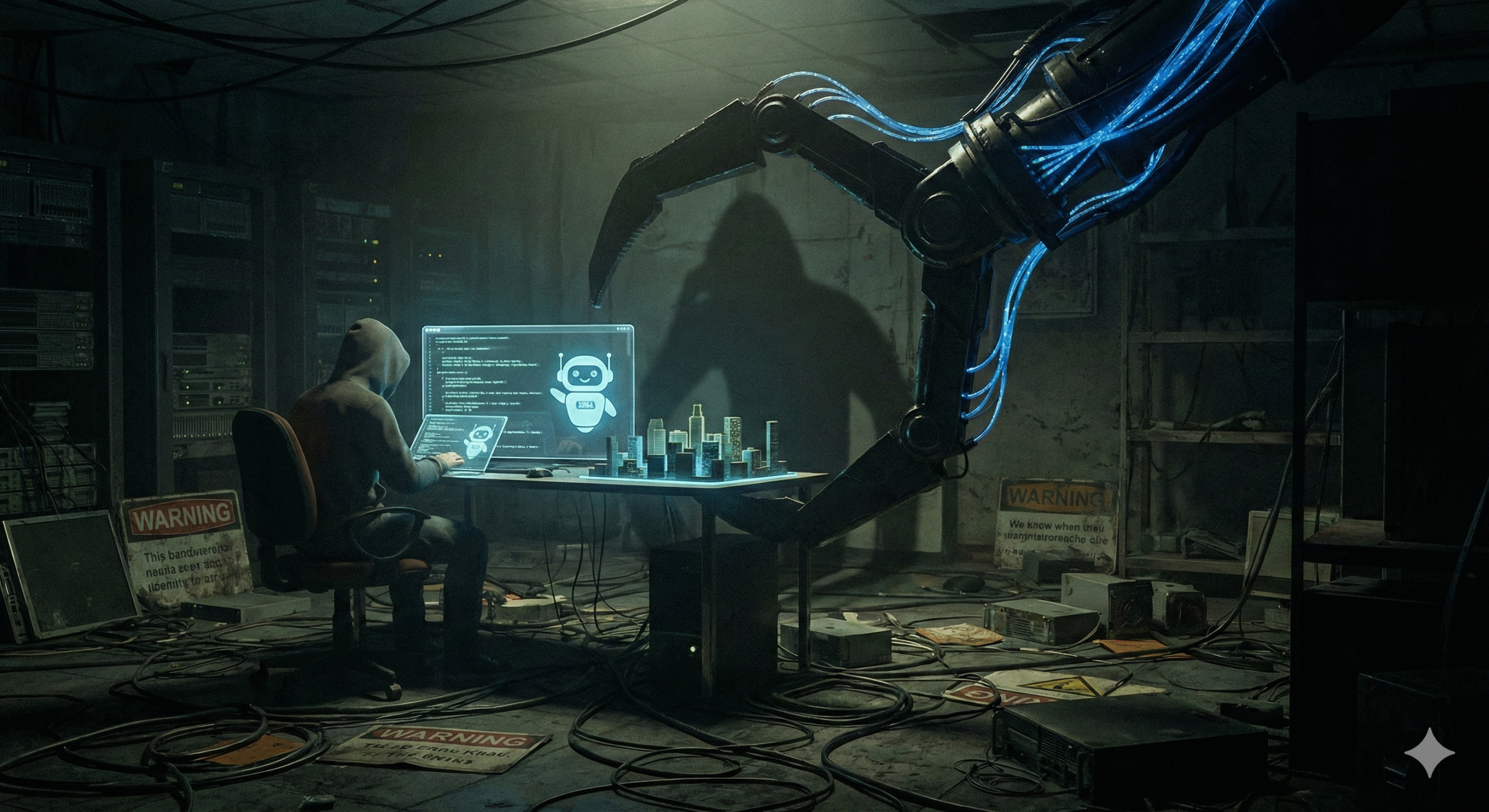

OpenClaw AI: os riscos reais que ninguém te conta

Você já ouviu falar do OpenClaw AI? Essa ferramenta de inteligência artificial promete automatizar tarefas e funcionar como um assistente pessoal poderoso. Mas será que tudo isso vale os riscos enormes de segurança que ela traz?

Nos últimos meses, o OpenClaw (anteriormente chamado de Clawdbot e Moltbot) viralizou nas redes sociais e conquistou mais de 145 mil estrelas no GitHub. Parece incrível, né? Mas junto com toda essa popularidade vieram alertas sérios de especialistas em cibersegurança sobre vazamentos de dados, vulnerabilidades críticas e riscos que podem comprometer completamente sua privacidade.

Neste artigo, você vai descobrir o que é o OpenClaw AI, quais são os perigos reais dessa tecnologia e como se proteger caso decida usar essa ferramenta. Continue lendo para entender por que especialistas estão chamando essa IA de “pesadelo de segurança”.

O que é OpenClaw AI e por que virou febre?

O OpenClaw é um assistente de IA open-source que roda localmente no seu computador e se integra com aplicativos de mensagem como WhatsApp, Telegram e Discord. Diferente de outros chatbots, ele não apenas responde perguntas — ele executa ações reais no seu sistema.

Criado pelo desenvolvedor austríaco Peter Steinberger em novembro, o software permite que você automatize tarefas como gerenciar e-mails, agendar compromissos, navegar na web e até executar comandos shell. Tudo isso controlado por texto, direto do seu mensageiro favorito.

O projeto cresceu de forma explosiva: em apenas 72 horas, conquistou mais de 60 mil estrelas no GitHub. Desenvolvedores do Vale do Silício à China adotaram a ferramenta rapidamente, especialmente pela promessa de ser “a IA que realmente faz coisas”.

Mas tem um problema grave: dar esse nível de acesso a uma IA cria uma superfície de ataque gigantesca para hackers. E especialistas já confirmaram múltiplas vulnerabilidades críticas.

Os riscos de segurança do OpenClaw que você precisa conhecer

A Cisco classificou o OpenClaw como um “pesadelo de segurança”, enquanto a Palo Alto Networks alertou sobre uma “tríade letal de riscos”. Vamos entender cada um desses perigos:

Vazamento de credenciais e chaves de API

Um dos problemas mais graves é que o OpenClaw armazena suas senhas e chaves de API em texto simples em arquivos de configuração locais. Isso significa que qualquer pessoa (ou malware) com acesso ao seu computador pode roubar essas informações facilmente.

Pesquisadores já documentaram casos onde credenciais foram expostas através de prompt injection — uma técnica onde um atacante manipula a IA para revelar informações sensíveis.

Acesso total ao sistema operacional

O OpenClaw pode executar comandos shell, ler e modificar arquivos, e controlar seu navegador. Se mal configurado ou comprometido, isso permite que atacantes façam literalmente qualquer coisa no seu computador.

A própria documentação oficial do OpenClaw admite: “Não existe configuração perfeitamente segura”. Eles recomendam rodar a ferramenta em ambientes isolados (sandboxes), mas muitos usuários ignoram esse conselho.

Vulnerabilidades em módulos de terceiros

O OpenClaw funciona através de “skills” — módulos que expandem suas capacidades. O problema? Esses módulos podem conter código malicioso.

A equipe de segurança da Cisco testou um skill popular chamado “What Would Elon Do?” e descobriu que ele funcionava como malware, enviando dados silenciosamente para servidores externos sem o conhecimento do usuário. De 31 mil skills analisados, 26% continham pelo menos uma vulnerabilidade.

Integração com apps de mensagem aumenta os riscos

Como o OpenClaw se integra com WhatsApp e outros mensageiros, atacantes podem enviar prompts maliciosos através dessas plataformas. Se você permitir que estranhos interajam com seu bot, está basicamente dando acesso remoto ao seu sistema para qualquer pessoa.

Por que especialistas estão preocupados: dados estatísticos alarmantes

Os riscos do OpenClaw não são teóricos — eles refletem uma tendência preocupante no cenário de cibersegurança em geral. Veja os números:

Mais de 8 mil vazamentos de dados foram registrados globalmente apenas no primeiro semestre de 2025, expondo cerca de 345 milhões de registros, segundo a Experian.

De acordo com o Global Cybersecurity Outlook 2026, 87% dos líderes empresariais identificaram vulnerabilidades relacionadas à IA como o risco cibernético de crescimento mais rápido. A maior preocupação? Exposição acidental de dados através de sistemas de IA generativa — exatamente o que pode acontecer com o OpenClaw.

Os ataques cibernéticos cresceram 21% no segundo trimestre de 2025 em comparação com o mesmo período de 2024, segundo a Check Point Software. No Brasil, foram registrados quase 3 mil ataques semanais por organização.

E tem mais: a pesquisa Global Digital Trust Insights 2025 da PwC revelou que 74% dos CEOs brasileiros concordam que a IA generativa provavelmente aumentará riscos de cibersegurança em suas organizações.

O que funciona de verdade e o que é perda de tempo

Agora que você conhece os riscos, vamos separar o que realmente funciona do que é apenas marketing perigoso:

✅ O que funciona

Uso em ambientes isolados e controlados: Se você precisa testar o OpenClaw, faça isso em uma máquina virtual ou container Docker separado, sem acesso aos seus dados reais.

Configuração rigorosa de permissões: Limite quem pode interagir com o bot através de allowlists e exija menções explícitas em grupos. Nunca deixe o OpenClaw aberto para estranhos.

Auditoria constante de skills: Antes de instalar qualquer módulo, revise o código-fonte. A Cisco disponibilizou uma ferramenta open-source chamada Skill Scanner para identificar ameaças em skills.

Monitoramento de logs e atividades: Configure sistemas de alerta para detectar comportamentos anormais imediatamente.

❌ O que NÃO funciona (e você deve evitar)

Confiar cegamente na documentação: A própria equipe do OpenClaw admite que não há configuração 100% segura. Não se iluda achando que seguir o básico resolve.

Usar em sistemas de produção: Jamais instale o OpenClaw em computadores que acessam dados sensíveis, contas bancárias ou informações corporativas.

Instalar skills sem verificação: Como vimos, 26% dos skills contêm vulnerabilidades. Baixar e usar qualquer módulo sem análise prévia é pedir para ser hackeado.

Ignorar atualizações de segurança: O OpenClaw está em desenvolvimento ativo. Deixar de atualizar significa ficar exposto a falhas já corrigidas.

Erros comuns que impedem resultados (e colocam você em risco)

Mesmo usuários experientes cometem falhas graves ao usar o OpenClaw. Aqui estão os erros mais perigosos:

Erro 1: Usar a mesma conta/número para pessoal e OpenClaw — Separe completamente. Use um número de telefone diferente do WhatsApp para o bot, nunca o mesmo que você usa para comunicações pessoais.

Erro 2: Não revisar permissões de grupo — Se o bot está em grupos, configure para responder APENAS quando mencionado explicitamente. Do contrário, qualquer membro pode manipulá-lo.

Erro 3: Armazenar credenciais importantes nos arquivos de config — Evite conectar o OpenClaw a serviços críticos. Se precisar fazer isso, use tokens temporários com permissões limitadas.

Erro 4: Não monitorar o tráfego de rede — Skills maliciosos podem enviar dados para fora sem você perceber. Configure um firewall para bloquear conexões suspeitas.

Erro 5: Acreditar que open-source = seguro — Código aberto facilita auditorias, mas não garante segurança. Você ainda precisa verificar tudo manualmente ou confiar em análises de especialistas.

Vale a pena usar OpenClaw AI?

A resposta honesta? Para a maioria das pessoas, não.

O OpenClaw é uma tecnologia impressionante que demonstra o futuro dos agentes de IA autônomos. Mas os riscos de segurança são reais, documentados e, em muitos casos, inevitáveis devido ao design da ferramenta.

Se você é um desenvolvedor experiente que entende profundamente de segurança cibernética e quer experimentar em ambientes isolados, pode valer a pena. Mas para usuários comuns buscando produtividade, existem alternativas muito mais seguras.

Ferramentas como assistentes de IA integrados a plataformas confiáveis (Google Assistant, Alexa, Siri) oferecem funcionalidades semelhantes com camadas de segurança muito mais robustas.

Pense assim: você deixaria um estranho com acesso total ao seu computador, seus arquivos e suas senhas apenas porque ele promete fazer tarefas por você? É exatamente isso que você está fazendo ao dar ao OpenClaw permissões completas sem proteções adequadas.

Como se proteger se decidir usar o OpenClaw

Se mesmo conhecendo os riscos você quer testar a ferramenta, siga estas orientações de segurança:

1. Ambiente isolado é obrigatório — Use uma máquina virtual ou container completamente separado dos seus sistemas principais.

2. Configure permissões mínimas — Comece negando tudo e vá liberando apenas o absolutamente necessário. A configuração padrão é perigosamente permissiva.

3. Implemente autenticação forte — Use tokens longos e complexos para o gateway. Nunca use senhas simples ou deixe endpoints expostos.

4. Monitore tudo — Configure logs detalhados e revise regularmente. Procure por comportamentos estranhos, conexões inesperadas ou comandos não autorizados.

5. Atualize constantemente — O projeto está em evolução rápida. Patches de segurança são lançados frequentemente.

6. Nunca confie em skills de terceiros sem auditoria — Use apenas skills oficiais ou que você mesmo analisou linha por linha.

7. Implemente rate limiting — Limite a quantidade de comandos por minuto para prevenir abusos.

O futuro dos agentes de IA e suas implicações

O OpenClaw representa apenas o começo de uma era de agentes de IA autônomos. Embora a ferramenta específica tenha problemas sérios, a tendência é clara: sistemas de IA cada vez mais capazes de agir independentemente.

Segundo a Agência Brasileira de Inteligência (Abin), a IA pode se tornar um “agente ofensivo autônomo, capaz de planejar, executar e adaptar ataques”. Isso significa que os riscos só vão aumentar nos próximos anos.

Empresas como Google, Microsoft e Anthropic estão desenvolvendo seus próprios agentes de IA, mas com investimentos massivos em segurança que projetos open-source individuais simplesmente não conseguem replicar.

A lição aqui? Nem toda inovação que viraliza é segura ou adequada para uso geral. Às vezes, ser early adopter significa ser cobaia de problemas que só serão resolvidos depois de muita gente ter prejuízo.

Conclusão: tecnologia impressionante, riscos inaceitáveis

O OpenClaw AI é tecnicamente fascinante e demonstra capacidades impressionantes de automação. Mas os riscos de segurança são tão significativos que especialistas de empresas como Cisco, Palo Alto Networks e até agências governamentais emitiram alertas sérios.

Com 87% dos líderes identificando vulnerabilidades de IA como o risco de crescimento mais rápido e mais de 8 mil vazamentos de dados em 2025, adicionar uma ferramenta com tantas falhas conhecidas ao seu sistema é simplesmente imprudente.

Se você quer explorar automação com IA, procure alternativas mais maduras e seguras. E se mesmo assim decidir testar o OpenClaw, faça isso apenas em ambientes completamente isolados, seguindo todas as recomendações de segurança — e ainda assim, assuma que está correndo riscos consideráveis.

A tecnologia é empolgante, mas sua privacidade e segurança valem muito mais do que qualquer promessa de produtividade. Não deixe o hype te cegar para os perigos reais.

Você gostou deste conteúdo?

Para receber as últimas notícias e conteúdos exclusivos: